INTRODUCTION

On voit l’IA générative arriver partout dans la formation : création de quiz, reformulation, feedback, scénarisation, tutorat, traduction, support apprenants, analyse des données… C’est puissant, c’est rapide, et ça change la productivité d’une équipe pédagogique. Mais Quid de la sobriété numérique ?

Mais il y a un angle mort qui devient impossible à ignorer : l’impact environnemental réel de ces usages. Parce qu’un déploiement IA “par défaut”, sans règles et sans mesure, peut créer une consommation invisible : plus d’énergie, plus d’eau, plus de matériel, et au final… plus de coûts (directs et indirects) pour l’organisation.

Le problème, c’est que le débat est souvent mal posé. On parle beaucoup de l’entraînement des modèles. Alors que, dans la formation, l’essentiel se joue surtout sur l’usage quotidien : des milliers de micro-requêtes, répétées, industrialisées, parfois automatisées. Et quand on additionne, l’impact n’est plus marginal.

Cet article propose une lecture opérationnelle, centrée formation en ligne. Où se situent les impacts, quels mécanismes les amplifient, et comment mettre en place une approche IA responsable et sobre ? (notamment via une logique de gouvernance type label ETHIC’IA

1- Sortir du mythe “c’est juste un prompt” : l’IA est un système complet

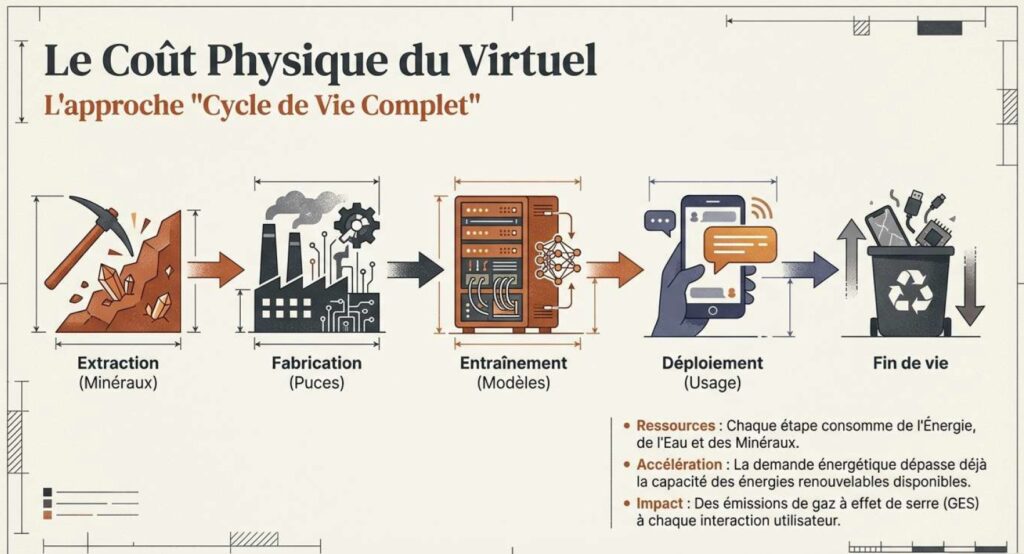

Un prompt, c’est un geste simple. Mais derrière, c’est une infrastructure lourde : serveurs spécialisés, réseaux, stockage, refroidissement, redondance, maintenance. Et tout cela repose sur du matériel fabriqué à partir de matières premières, transporté, assemblé, renouvelé.

Dans le e-learning, cette réalité change tout, parce qu’on ne parle pas d’un usage ponctuel. On parle d’un flux continu : les équipes production génèrent, les formateurs testent, les apprenants interrogent, le support répond, le LMS s’enrichit, des assistants s’installent partout.

Donc la première bascule à faire, c’est celle-ci : même si je n’entraîne pas de modèles, je peux être un gros contributeur d’impact via l’inférence (l’usage). Et si je n’encadre pas cet usage, je consomme plus, souvent sans se rendre compte.

Ce que ça implique, concrètement :

- L’impact dépend fortement du volume d’usage, et de la façon dont l’IA est intégrée (automatique vs à la demande).

- La qualité pédagogique devient un levier de sobriété : un bon design réduit les appels inutiles à l’IA. (éco-conception)

- La gouvernance compte autant que le choix de l’outil.

2 – Énergie & carbone : l’inférence est le sujet n°1 pour la formation

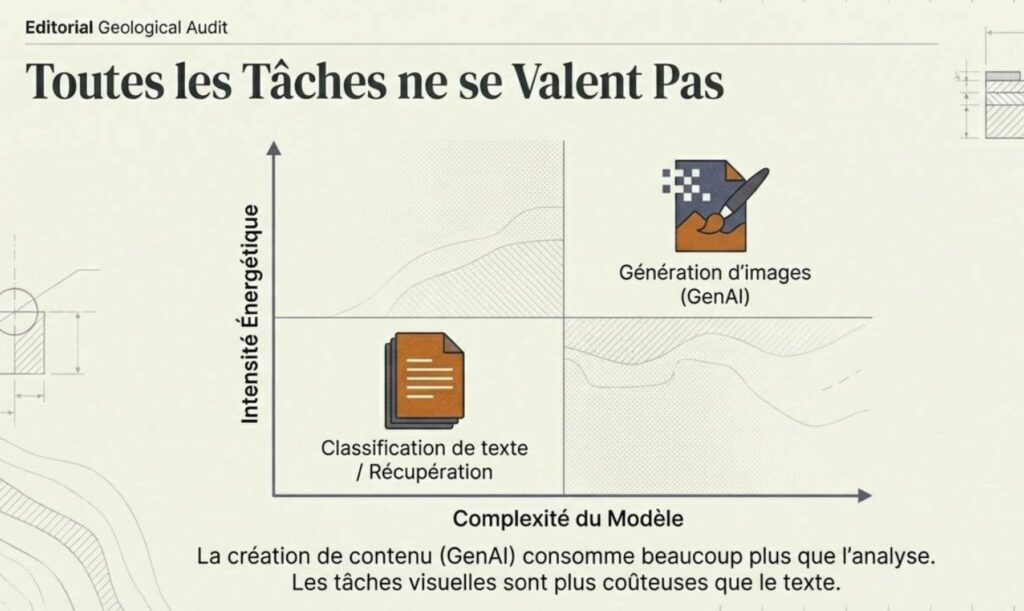

On peut résumer simplement : dans la formation, l’impact vient surtout de la répétition des usages.

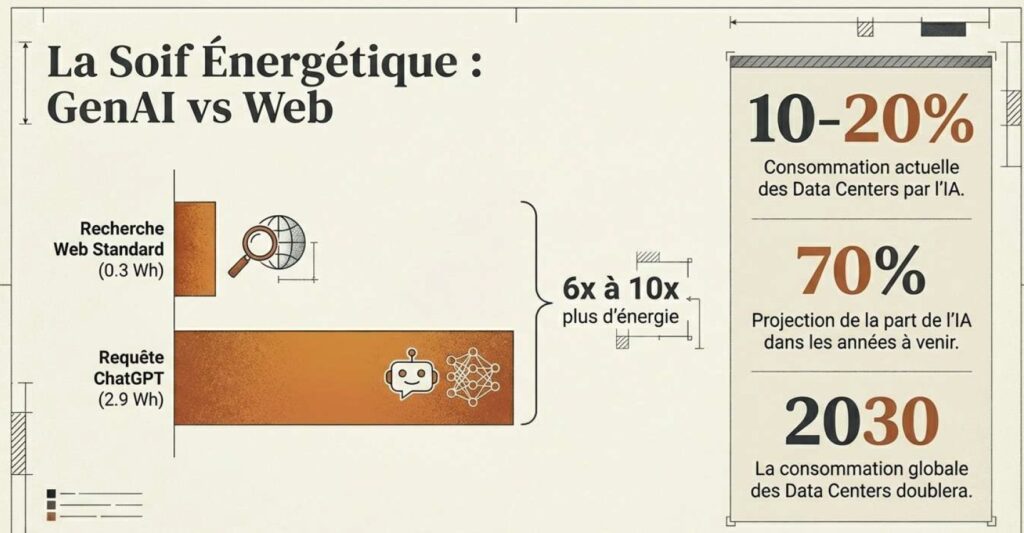

Un ordre de grandeur aide à se représenter la différence : une recherche web “classique” consomme typiquement une fraction de Wh, alors qu’une requête IA générative se situe plusieurs fois au-dessus. Les valeurs exactes varient selon le modèle, l’infrastructure, la localisation, le mix électrique… mais la tendance est stable : remplacer massivement des actions légères par des requêtes génératives plus coûteuses augmente mécaniquement la demande énergétique.

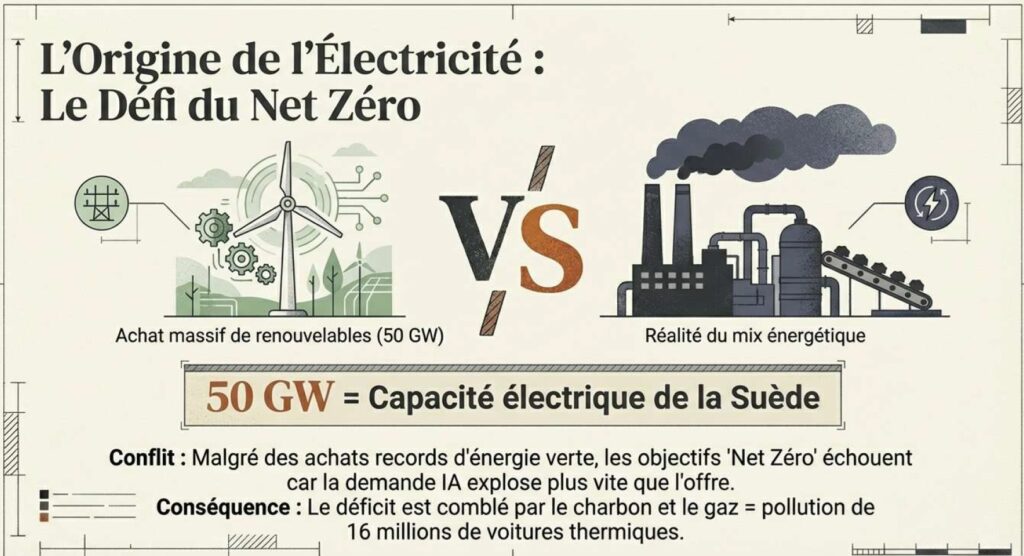

Et il y a un deuxième point : l’énergie n’a pas la même intensité carbone selon les pays, les saisons, les heures. L’empreinte dépend du contexte. Et si l’on multiplie les usages sans stratégie, on peut obtenir une situation paradoxale : une IA utile localement, mais déployée de manière inefficiente à l’échelle du système.

Dans le e-learning, c’est très visible sur un piège courant : l’IA temps réel partout.

- Générer à la volée un cours, puis le régénérer, puis le “re-régénérer” pour le style.

- Générer des quiz à l’infini.

- Demander des reformulations successives pour faire plus engageant.

Résultat : beaucoup d’énergie consommée pour des gains pédagogiques parfois faibles.

Le bon réflexe : réserver l’IA temps réel aux moments où elle change vraiment l’apprentissage (remédiation, feedback individualisé, tutorat sur demande, adaptation), et stabiliser le reste.

3 – L’eau : l’impact invisible et très local

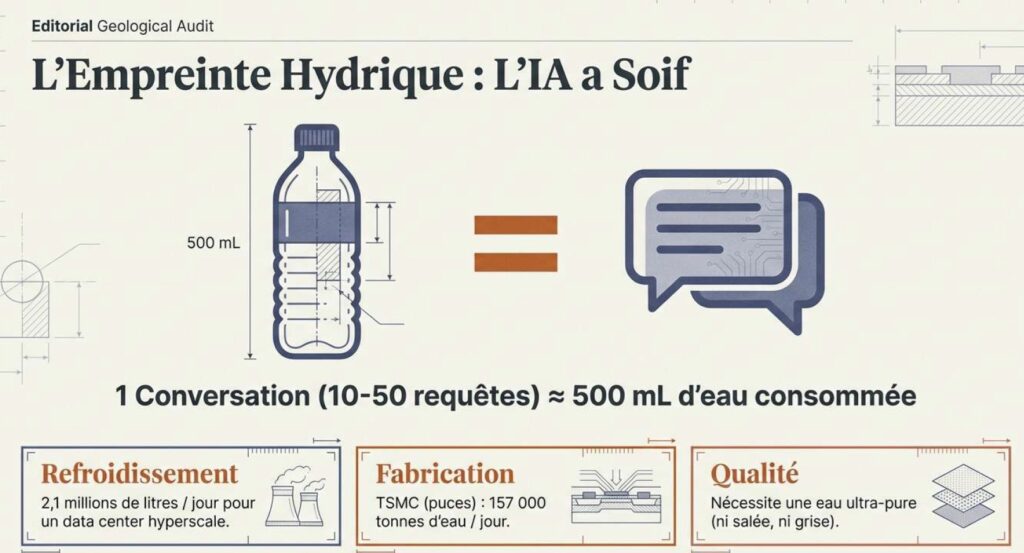

L’eau est rarement discutée, pourtant elle est critique. Une partie de l’IA repose sur des data centers qui doivent être refroidis, et ce refroidissement peut mobiliser de l’eau (directement ou indirectement via la production d’électricité). Cela ne signifie pas que chaque prompt boit un verre d’eau de manière simple et directe, mais cela signifie qu’à grande échelle, l’usage intensif d’IA augmente la pression sur des ressources locales.

Et c’est là que la sobriété devient très concrète pour la formation : si j’industrialise des assistants IA sans priorisation, je participe à une consommation d’eau qui s’ajoute à d’autres usages, parfois dans des zones déjà sous tension.

Ce que je recommande aux organisations formation :

- Mettre l’eau dans les critères de sélection fournisseur (transparence, politique de refroidissement, engagements).

- Éviter les fonctionnalités IA toujours actives quand elles n’ont pas d’utilité pédagogique claire.

- Mieux former les équipes et les apprenants pour réduire la régénération inutile (éviter le « je relance jusqu’à ce que ce soit parfait”).

4 – Matériel & matières premières : l’empreinte hardware est un énorme morceau

L’IA a besoin de matériel spécifique, notamment pour accélérer les calculs. Et ce matériel a une empreinte de fabrication significative : extraction, raffinage, production, transport, fin de vie. Autrement dit, une partie de l’impact est en amont et ne dépend pas seulement de l’électricité consommée pendant l’usage.

Il y a un point souvent contre-intuitif : une partie de l’empreinte provient aussi du fait que l’infrastructure tourne même quand elle n’est pas utilisée à pleine capacité. Les systèmes doivent rester disponibles, dimensionnés pour des pics, avec de la redondance. Donc optimiser uniquement le modèle n’est pas suffisant : il faut optimiser l’architecture, l’usage, et la mutualisation.

Dans le digital learning, ça mène à des arbitrages très concrets :

- AI partout vs AI ciblée sur les points de friction apprenant.

- Génération à la volée vs contenus robustes, versionnés, réutilisables.

- Vidéo systématique vs scénarios alternatifs plus sobres (interactions, activités, micro-contenus, audio court, ressources optimisées) –> Eco-conception

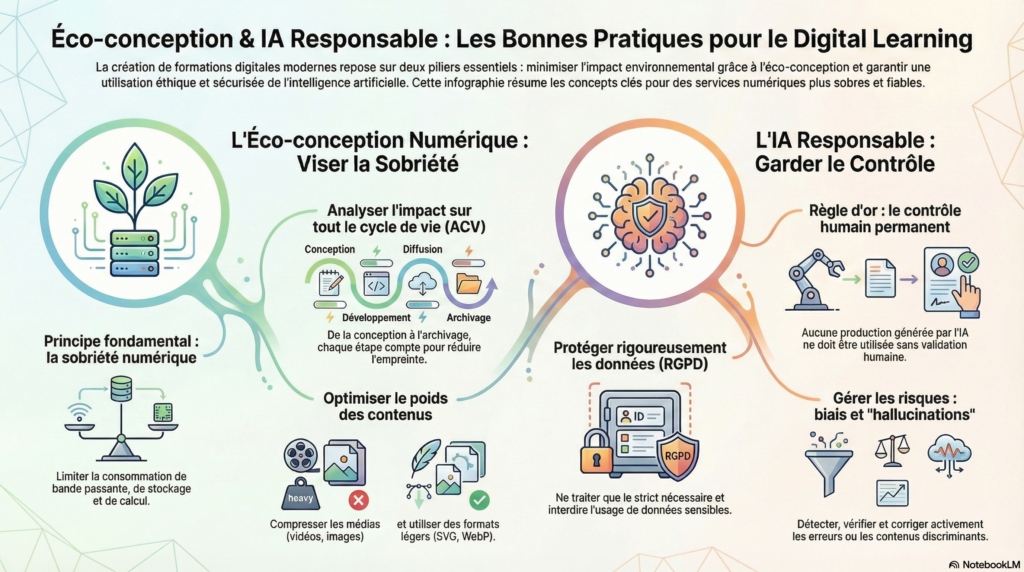

L’éco-conception des formations est autant utile pour la sobriété numérique que pour l’amélioration de la pédagogie.

5 – Plan d’action : sobriété IA appliquée au e-learning (et gouvernance ETHIC’IA)

Passons à l’opérationnel. L’objectif n’est pas de “faire moins d’IA”. L’objectif est de faire de l’IA utile, mesurable, pilotable.

A) Concevoir “sobriété by design” (la pédagogie est un levier d’impact)

- Stabiliser ce qui doit l’être : objectifs, trame, référentiels, évaluations sommatives, supports clés.

- Utiliser l’IA pour ce qu’elle fait mieux : feedback contextualisé, exemples personnalisés, génération de contenus (si pas existant à adapter).

- Réduire la boucle de régénération : utiliser des gabarits (prompts internes), des critères qualité, des checklists de validation.

- Favoriser la réutilisation : capitaliser, versionner, mutualiser (un bon item pédagogique vaut mieux que 20 variantes jetables).

B) Encadrer les usages (sinon l’outil décide à votre place)

- Définir qui valide quoi : rôle de l’expert métier, de l’ingénieur pédagogique, du formateur.

- Préférer l’IA sur demande à l’IA automatique quand le gain pédagogique n’est pas démontré.

- Mettre des règles simples : pas d’IA pour faire joli, pas d’IA pour multiplier des contenus redondants, pas d’IA pour remplacer une conception absente.

C) Mesurer pour piloter (même avec des indicateurs simples).

Sans instrumentation complexe, on peut déjà suivre :

- nombre de générations par semaine (production / support / apprenants)

- taux de régénération (combien de fois on relance)

- typologie des usages (quiz, synthèse, feedback, support)

- part temps réel vs contenu stabilisé. Ces indicateurs servent à repérer les fuites : usage élevé, faible valeur, forte répétition.

D) Exiger la transparence et la pilotabilité.

Une IA responsable, ce n’est pas une déclaration. C’est une capacité à démontrer et à gouverner.

Voilà des critères très concrets à intégrer :

- Transparence des outils : métriques publiées (énergie/carbone/eau), périmètre, méthode.

- Pilotabilité : possibilité de choisir des modèles plus légers, limiter la longueur des réponses, désactiver l’auto génération.

- Sobriété technique : preuves d’optimisation (modèles efficients).

- Data & sécurité : minimisation, conservation, localisation, protection (c’est aussi de la sobriété : moins de flux inutiles).

- Gouvernance : documentation, règles d’usage, formation des utilisateurs, procédures de contrôle qualité.

E) Former les apprenants et les ingénieurs pédagogique à une IA responsable et efficace

Former à l’IA sans méthode crée une surconsommation : prompts flous, régénérations, usage permanent, dépendance.

Un micro Learning sur :

- quand utiliser l’IA (et quand s’en passer)

- comment obtenir une bonne réponse dès la première requête

- comment réutiliser / citer / versionner plutôt que régénérer

- comment vérifier (qualité, biais, sources)

CONCLUSION

L’IA peut améliorer la formation, mais seulement si on sort du réflexe on l’utilise dans tous les cas. L’enjeu n’est pas moral. Il est stratégique : performance pédagogique, maîtrise des coûts, conformité, image, et responsabilité.

La sobriété numérique appliquée à l’IA, ce n’est pas une contrainte : c’est un cadre de qualité. Dans la formation, on a une chance unique : notre métier, c’est de concevoir des usages. Donc on peut faire mieux que consommer de l’IA.

La voie la plus robuste, c’est une IA gouvernée : cas d’usage priorisés, design pédagogique sobre, mesure simple, exigences fournisseur, et un référentiel clair pour objectiver le niveau de responsabilité. C’est exactement l’esprit d’une démarche type ETHIC’IA. (Label IA responsable pour la formation)

Pour info : Nous organisons un Digital Cleanup SENSIBILISATION (le 19 mars à 11h30) en visio sur « La Sobriété Numérique dans la formation en ligne »

Inscrivez-vous : La Sobriété Numérique dans la formation en ligne – Digital Cleanup Day